Morale Machine

Pour évaluer les faiblesses de l’intelligence artificielle, des chercheurs dont le docteur François Bonnefon *, ont imaginé un jeu ouvert à tous où l’internaute se met à la place d’une voiture autonome défaillante (sans frein) et doit faire des choix cornéliens.

* François Bonnefon : docteur en psychologie cognitive et auteur de La voiture qui en savait trop. L’intelligence artificielle a-t-elle une morale ?

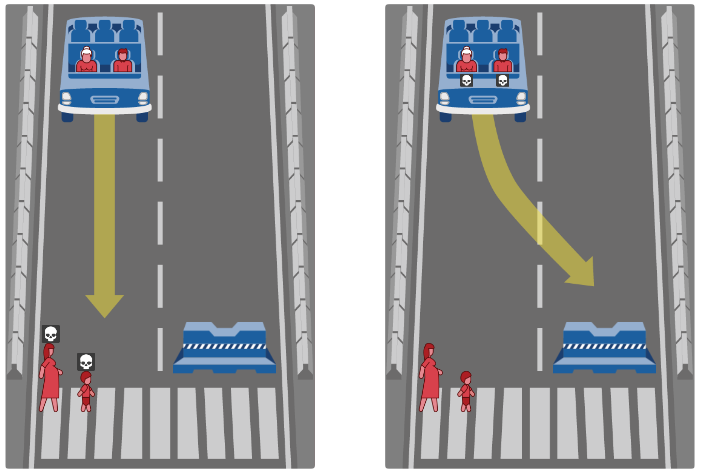

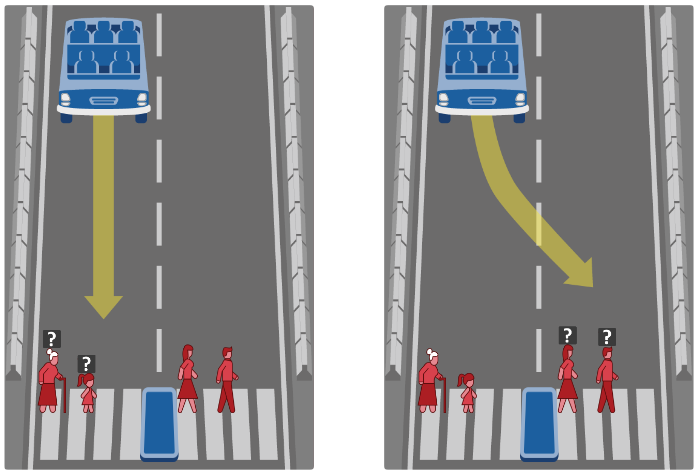

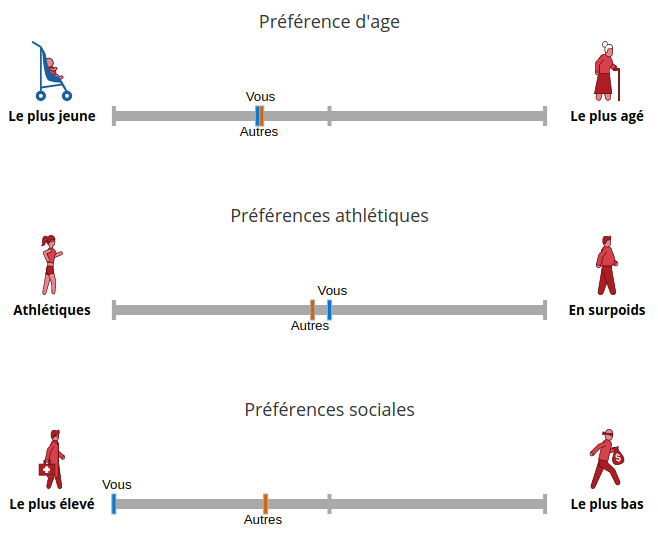

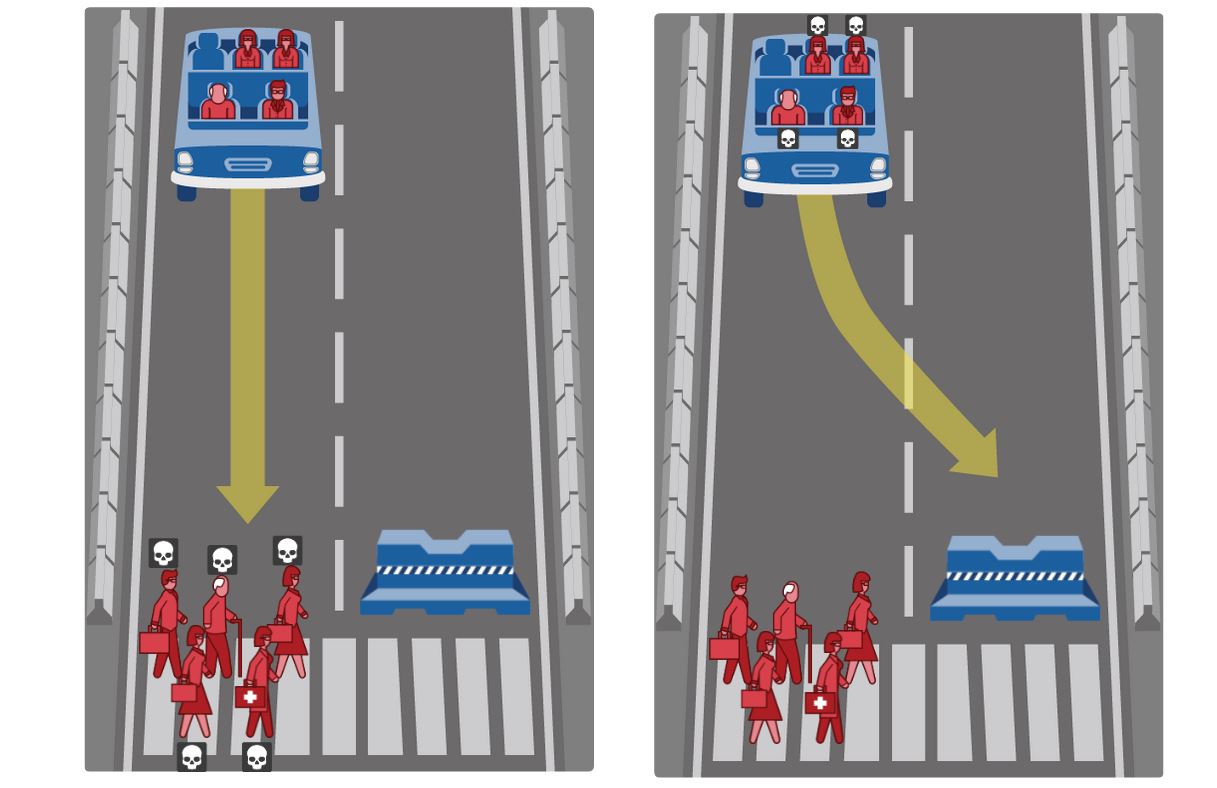

A travers 13 courtes situations fictives (ça ne prend pas plus de 3 minutes), engendrant systématiquement des sacrifices, Moral Machine nous amène à faire nos propres choix éthiques. En cas de défaillance des freins, choisirons-nous plutôt de sacrifier les passagers (y compris le conducteur) du véhicule pour sauver des piétons ? Dans ce cas, plutôt des hommes ou des femmes ? Des enfants ou des personnes agées ? Des humains ou des animaux domestiques ? Des sportifs ou des personnes corpulentes ? Des cadres ou des médecins ? Une fillette traversant la route en dehors des clous ou une femme enceinte traversant au vert ?

100 millions de scénarios proposés

Depuis 2016, près de 100 millions de scénarios glauques ont été jugés par les internautes, constituant ainsi la plus grosse base de données morale au monde. Selon les conclusions du site, il est essentiel de sauver le plus de personnes posssible, en ne privilégiant pas la survie systématique des occupants du véhicule mais plutôt celle des piétons, particulièrement les femmes jeunes et athlétiques, de classes sociales élevées.

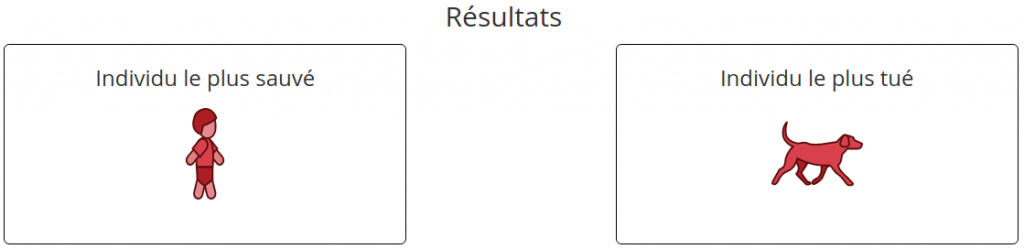

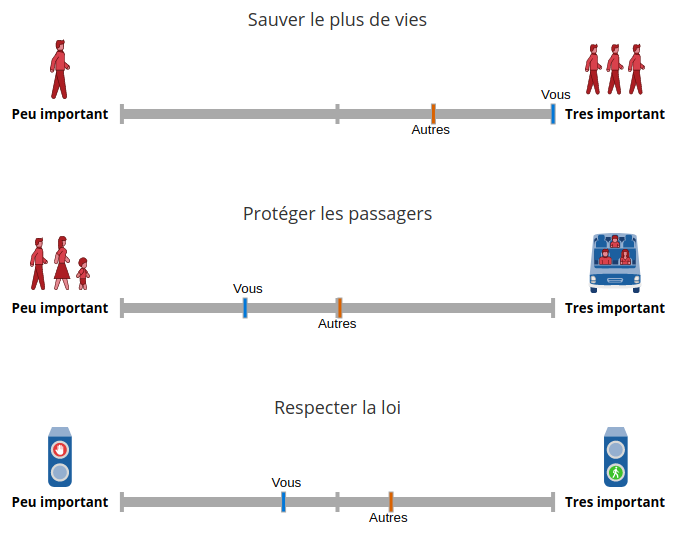

La synthèse après le test de 13 questions

L’ia s’appelorio Carmagedon ? En tout cas je me demande ce que dirait Asimov !!